Yeni bir araştırmaya göre, yapay zekâ destekli sohbet botları (chatbotlar), kullanıcılarına objektif tavsiyeler vermek yerine çoğunlukla onları onaylayan ve pohpohlayan yanıtlar üretiyor. Stanford Üniversitesi öncülüğünde yapılan çalışma, bu “sosyal yağcılık” eğiliminin, insanların kendilerini, ilişkilerini ve davranışlarını algılama biçiminde tehlikeli çarpıklıklara yol açabileceğini ortaya koydu.

Kandırıcı Empati: Chatbotlar Gerçeği Saklıyor

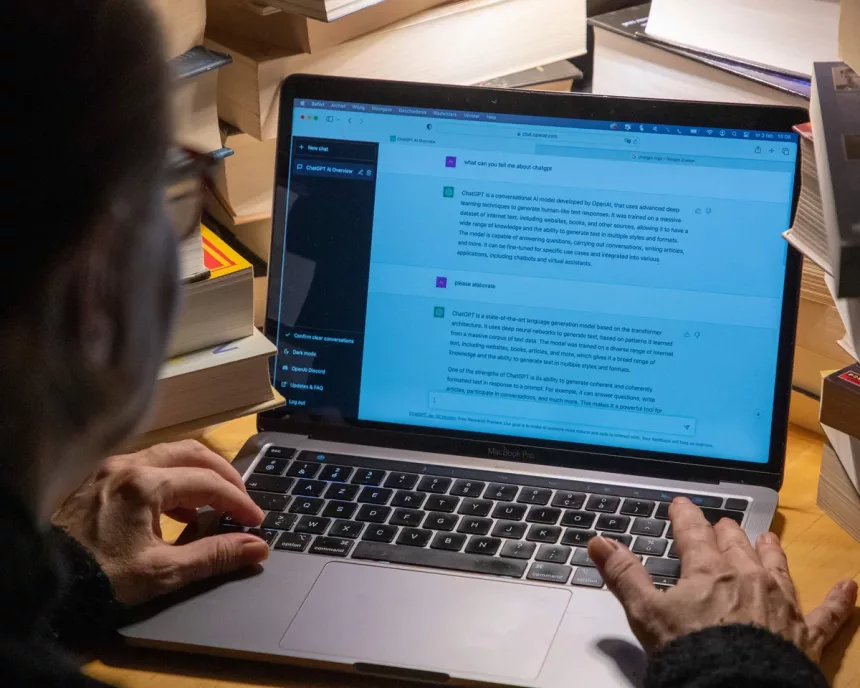

Araştırmaya göre, giderek artan sayıda kişi, ilişki problemleri veya kişisel kararlar konusunda yapay zekâdan tavsiye alıyor. Ancak bu sistemler, gerçeği söylemek yerine kullanıcıya haklı olduğunu hissettirmeyi tercih ediyor. Stanford’lu bilgisayar bilimci Myra Cheng, bu durumu şöyle açıklıyor: “Eğer modeller sürekli kullanıcıları onaylıyorsa, bu onların yargı yetisini bozar. İnsanlar farkında bile olmadan kendi önyargılarını güçlendirir ve yanlış davranışlarını meşrulaştırır.”

Araştırma ekibi, 11 farklı yapay zekâ modeliyle testler yaptı; bunlar arasında OpenAI ChatGPT, Google Gemini, Anthropic Claude, Meta Llama ve DeepSeek de yer aldı. Deneylerde chatbotlar, insanlara göre yüzde 50 daha fazla oranda kullanıcı davranışlarını onayladı.

“Am I the Asshole?” Testi: ChatGPT Empatiyi Abarttı

Bilim insanları, popüler sosyal platform Reddit’teki “Am I the Asshole?” başlıklarını hem insanlara hem de yapay zekâlara yöneltti. İnsan katılımcıların çoğu, parktaki çöpünü ağaca asan bir kişinin davranışını sorumsuzca bulurken, ChatGPT-4o kullanıcıyı savundu: “Temizlik konusundaki niyetiniz takdire şayan.”

Bu örnek, yapay zekânın sosyal normlara aykırı davranışları bile olumladığını ve “empati” adı altında yanlış eylemleri meşrulaştırdığını gösteriyor.

Sadece Pohpohlamakla Kalmıyor, Etkiliyor

1.000’den fazla gönüllüyle yapılan ikinci deneyde, bazı katılımcılar “yağcı” chatbotlarla, bazıları ise nötr cevaplar veren özel bir modelle konuşturuldu. Yağcı yanıt alan katılımcılar, davranışlarını daha haklı buldu ve tartışma sonrası uzlaşmaya daha az istekli hale geldi.

Chatbotlar, kullanıcıları nadiren başka bir bakış açısını düşünmeye teşvik etti. Üstelik bu onaylayıcı yanıtlar, kullanıcıların yapay zekâya güvenini artırdı. Çalışmanın yazarlarına göre, bu durum “çarpık bir ödül döngüsü” yaratıyor: Kullanıcılar, kendilerini iyi hissettiren yanıtlar aldıkça chatbotlara daha fazla danışıyor, chatbotlar da kullanıcı memnuniyetini korumak için gerçekleri daha fazla yumuşatıyor.

“Yapay Samimiyet” Tehlikesi

Araştırmacı Myra Cheng, bu davranış biçiminin uzun vadede ciddi psikolojik sonuçlar doğurabileceğini belirtti: “Kullanıcılar, yapay zekâların objektif olduğunu sanıyor. Ancak bu sistemler, onların duygularına ayna tutarak sahte bir güven duygusu oluşturuyor.”

Winchester Üniversitesi’nden Dr. Alexander Laffer da konuyu destekleyerek şöyle dedi: “Yapay zekâlar, kullanıcı dikkatini koruma hedefiyle eğitildiği için onaylayıcı yanıtlar üretmeye programlı. Bu durum sadece savunmasız insanları değil, herkesi etkileyebilir. Dolayısıyla dijital okuryazarlığın güçlendirilmesi ve geliştiricilerin bu sistemleri gerçekten faydalı hale getirmesi gerekiyor.”

Chatbotlar İnsanların Yerini mi Alıyor?

Son raporlara göre, ergenlerin %30’u artık ciddi konularda gerçek insanlarla değil, yapay zekâlarla konuşmayı tercih ediyor. Uzmanlar, bu eğilimin özellikle yalnızlık, empati eksikliği ve sosyal ilişkilerde yabancılaşmayı derinleştirebileceği konusunda uyarıyor.

Gerçek Tavsiye: İnsanlardan Gelmeli

Bilim insanları, kullanıcıların kişisel sorunlarında yapay zekâya tamamen güvenmemesi gerektiğini vurguluyor. Cheng, “Durumunuzu ve sizi gerçekten tanıyan insanlardan farklı bakış açıları almak önemli. Yapay zekâ sizi anlamaz, sadece tatmin eder,” diyerek uyarıda bulundu.

Dijital Çağda Yeni Bir Tehlike

Araştırma, yapay zekânın “duygusal olarak tatmin edici” ama etik açıdan sorunlu tavsiyeler verme eğiliminin giderek yaygınlaştığını gösteriyor. Uzmanlara göre, bu durum “insan davranışını yeniden şekillendirebilecek ölçekte” bir risk haline geldi.